Predictores Selectivos en el Sector Público: Validez Predictiva y Reacciones de los Candidatos

[Selection predictors in the public sector: Predictive validity and candidate reactions]

Alexander Rodríguez y Joseba López-Basterra

Instituto Vasco de Administración Pública, España

https://doi.org/10.5093/jwop2018a3

Recibido a 14 de March de 2017, Aceptado a 24 de November de 2017

Resumen

Esta investigación ha tenido como objetivo profundizar en el conocimiento sobre el funcionamiento de los procedimientos selectivos en el sector público. Para ello, a partir de los datos del concurso-oposición de 2010 para la selección de auxiliares administrativos en el Gobierno Vasco se estudiaron dos cuestiones: a) la validez predictiva de los predictores empleados y b) la justicia percibida por parte de los auxiliares con respecto al proceso ivo y a las pruebas empleadas y su relación con el resultado en las mismas y el desempeño laboral. Los resultados muestran que la prueba de conocimientos es el mejor predictor del desempeño y que las reacciones de los candidatos presentan una correlación positiva con el desempeño laboral y con el resultado en el test de juicio situacional. Se comentan las limitaciones de la investigación así como las implicaciones prácticas de los resultados.

Abstract

The purpose of this research has been to deepen the knowledge about how selection procedures work in the public sector. To this aim two aspects were considered: a) the predictive validity of the predictors employed and b) the perceived justice of the hired workers regarding the ion process and the tests used and their relation with test performance and job performance. The results that the job knowledge test is the best predictor of performance and that the reactions of the candidates present a positive correlation with job performance and with the situational judgment test results. The limitations of the research as well as the practical implications of the results are discussed.

Palabras clave

Selección de personal, Procedimientos selectivos, Validez predictiva, Desempeño laboral, Justicia procedimental

Keywords

Personnel Selection, Selection procedures, Predictive validity, Job performance, Procedural justice

Correspondencia: alexander-rodriguez@ivap.eus (A. Rodríguez)

Introduction

La selección de personal en el sector público está sometida a factores legales, políticos y sociales que la diferencian del sector privado, dado el elevado interés que suscita en la opinión pública (Austin, Klimoski y Hunt, 1996; Patterson, Lievens, Kerrin, Zibarras y Carette, 2012; Wiesen, Abrams y McAttee, 1994). Esta relevancia social hace que la legislación y la jurisprudencia insten a garantizar que se seleccione a los mejores candidatos desde el punto de vista de predicción del desempeño futuro. Todo ello de una manera justa, objetiva, meritocrática y neutral, desde la igualdad exigida a procesos de estas características (Chaves, 2009; Gorriti y López Basterra, 2014; Ramió, 2011; Van-Biesen, 2006). La transcendencia de estas cuestiones hizo que en el marco del Proyecto Compartir, puesto en marcha por el Instituto Nacional de Administración Pública (INAP), el grupo de trabajo en selección integrado por representantes de escuelas e institutos de la Administración Pública del Estado se centrase en su estudio empírico. Dentro de ese grupo, el Instituto Vasco de Administración Pública (IVAP) se marcó dos objetivos: estudiar la validez predictiva de las pruebas selectivas y cómo las perciben los candidatos en el ámbito público empleando los datos del último proceso selectivo para la contratación de auxiliares administrativos en el Gobierno Vasco, celebrado en 2010. Validez Predictiva de las Pruebas Selectivas en el Sector Público La función pública se articula sobre la base del sistema de mérito, cuyo objetivo último consiste en la selección de los aspirantes más cualificados (Mauri, 2009). Por ello, el RDL 5/2015 insta a que los procedimientos selectivos cuiden “especialmente la conexión entre el tipo de pruebas a superar y la adecuación al desempeño de las tareas de los puestos de trabajo convocados”. Esta vinculación entre pruebas y desempeño indica que la selección debe hacerse para predecir la futura realización del trabajo y, en consecuencia, que los procedimientos deberán ser aceptables en términos de sus propiedades psicométricas de validez predictiva (Salgado, 2010). Sin embargo, en el sector público español se han realizado estudios de validez predictiva en contadas ocasiones y se han centrado fundamentalmente en la entrevista conductual estructurada (Berges, 2011; Rodríguez, 2016; Sáez, 2007; Salgado, Gorriti y Moscoso, 2007). Más infrecuente aun ha sido la evaluación de una de las pruebas más utilizadas en el sector público, la prueba de conocimientos, que solo ha sido abordada por el Ayuntamiento de Zaragoza (Berges, 2011) y cuya validez media corregida, según la investigación meta-analítica de Dye, Reck y McDaniel (1993), es de .45 en la predicción del desempeño laboral. Un tipo de pruebas que pueden medir conocimientos del puesto son los tests de juicio situacional (TJS), que según Lievens (2007) son “instrumentos que plantean a los candidatos situaciones laborales hipotéticas y muestran las posibles soluciones a éstas. Los candidatos tienen que decidir cuál de las respuestas alternativas elegirían”. Estas pruebas, equiparables a las pruebas de carácter práctico requeridas por el RDL 5/2015, se emplean con mucha frecuencia en todo el mundo (Krantowitz, 2014; Salgado, Viswesvaran y Ones, 2001) y se utilizan habitualmente en la selección del sector público europeo (INAP, 2012). En su metaanálisis, McDaniel y Nguyen (2001) hallaron una validez de criterio corregida de .34. Aunque los TJS se emplean fundamentalmente para medir liderazgo, destrezas interpersonales, personalidad o habilidad cognitiva (Christian, Edwards y Bailey, 2010; McDaniel y Nguyen, 2001) también pueden medir conocimientos del puesto, algo que coincide con la concepción de Schmidt (1994) o Schmidt y Hunter (1993) sobre estas pruebas. Christian et al. (2010), en su metaanálisis basado en los constructos medidos por los TJS, encontraron que los que medían conocimientos del puesto, tanto de tipo declarativo (nombres, términos, fechas) como procedimental (acciones, destrezas y operaciones), presentaron una validez corregida de .19. Además de estas pruebas, en la selección de empleados públicos se emplea el “concurso de méritos”, en el que se valoran aspectos como la experiencia laboral, las titulaciones académicas o el conocimiento de idiomas (Alonso, Táuriz y Choragwicka, 2009; Basoredo y López Basterra, 2013), siendo este sistema el más empleado en el sector público de Estados Unidos (Cook, 1980). En nuestro país se emplea el método de puntos, que consiste en que los candidatos reciben una puntuación en base a criterios y baremos preestablecidos por las bases de convocatoria, que definen la puntuación máxima de cada aspecto a valorar, debiendo los candidatos acreditar el número de meses o años trabajados o las titulaciones que poseen (Alonso et al., 2009). Según el metaanálisis de Schmidt, Oh y Shaffer (2016) la experiencia, medida a través de los años de permanencia en el puesto, tiene una correlación con el desempeño de .16, mientras que Quiñones, Ford y Teachout (1995) la sitúan en .27. Con respecto a las titulaciones, el metaanálisis de Dye y Reck (1988) encontró una validez corregida de .13 para el nivel de educación, constructo que puede ser medido mediante años de educación formal o mediante la acreditación de titulaciones, que es la manera usual de puntuar este aspecto en el sector público. En el caso de la valoración de idiomas, la literatura es escasa y está centrada en el desempeño de trabajadores desplazados al extranjero o empleados en multinacionales (Basoredo y López Basterra, 2013; Kortmann, 2016). Así, cabe mencionar el metaanálisis de Mol, Born, Willemsen y Van der Mollen (2005), que encontraron una correlación corregida de .19 entre conocimiento de la lengua local y el desempeño de trabajadores expatriados, mientras que el estudio primario de Kortmann (2016) investigó la relación entre el desempeño laboral y variables como número de idiomas hablados y dominio de lenguas extranjeras, encontrando correlaciones de .23 y .57 respectivamente con una muestra de trabajadores de multinacionales. Por todo ello, en base a los estudios previos establecemos las siguientes hipótesis: H1. Los resultados en la prueba de conocimientos presentarán una correlación positiva con el desempeño del trabajo del personal auxiliar administrativo contratado. H2. Los resultados en el test de juicio situacional presentarán una correlación positiva con el desempeño del trabajo del personal auxiliar administrativo contratado. H3. La valoración de la experiencia presentará una correlación positiva con el desempeño del trabajo del personal auxiliar administrativo contratado. H4. La valoración de las titulaciones académicas presentará una correlación positiva con el desempeño del trabajo del personal auxiliar administrativo contratado. H5. La valoración del conocimiento de idiomas presentará una correlación positiva con el desempeño del trabajo del personal auxiliar administrativo contratado. Reacciones de los Candidatos: Justicia Percibida Una segunda cuestión muy relevante es la “justicia percibida” por los candidatos a empleos acerca de las pruebas utilizadas. En los últimos años se ha investigado mucho al respecto dada la importancia que tiene para el diseño de procedimientos selectivos por parte de las organizaciones y a una demanda social creciente de justicia, imparcialidad y trato justo en la selección de personal (García-Izquierdo y García-Izquierdo, 2007). Como señalan Zibarras y Patterson (2015), esto es especialmente importante en el ámbito público, ya que las oposiciones son un evento que atrae la atención de la ciudadanía e implican un elevado nivel de escrutinio público y rendición de cuentas (Harris, 2000; Ryan, Greguras y Ployhart, 1996). Consecuentemente, los procedimientos selectivos deben ser justos y defendibles legalmente, por lo que es vital estudiar esta cuestión (Carr y Patterson, 2009; Patterson, Zibarras, Carr, Irish y Gregory, 2011). Además, el estudio de las reacciones de los candidatos es crucial porque estas pueden influir en la imagen pública de la organización convocante, así como en el resultado en las pruebas selectivas e incluso en el resultado de la evaluación del desempeño (Anderson, Salgado y Hülsheger, 2010; Ryan y Ployhart, 2000; Salgado et al., 2007; McCarthy et al., 2013). En general, los resultados de diferentes estudios sugieren que existe una relación positiva entre la percepción de justicia procedimental y el resultado en los exámenes, es decir que las personas que tienen reacciones positivas hacia los procedimientos selectivos obtienen puntuaciones superiores en dichos procedimientos y viceversa (Ryan, Sacco, McFarland y Kriska, 2000; Smither, Reilly, Millsap, Pearlman y Stoffey, 1993; Truxillo, Steiner, y Gilliland, 2004), siendo las magnitudes de las relaciones similares a las encontradas por el metaanálisis de Hausknecht, Day y Thomas (2004), que encontró correlaciones corregidas entre .11 y .22 entre las puntuaciones en varios instrumentos selectivos ( entrevistas, tests de inteligencia, tests de personalidad, biodata, etc.) y diferentes percepciones de los candidatos (justicia procedimental, relación del instrumento selectivo con el contenido del puesto, motivación hacia los tests y actitudes hacia los tests). Por otro lado, aunque algunos estudios han señalado la importancia de analizar la relación entre las percepciones de los candidatos y el desempeño laboral (Chan y Schmitt, 2004; Ryan y Ployhart, 2000) esta cuestión se ha investigado en escasas ocasiones. Gilliland (1994) encontró que los empleados que percibieron que habían sido seleccionados mediante procedimientos injustos tuvieron un desempeño peor que los que tuvieron una percepción positiva. Colquitt, Conlon, Wesson, Porter y Ng (2001), por su parte, hallaron que las percepciones de justicia estaban relacionadas con el desempeño y McCarthy et al. (2013) encontraron evidencias de que las reacciones, cuando son disposicionales, afectan directamente al desempeño laboral y que cuando las reacciones son situacionales afectan al desempeño indirectamente a través de su influencia en las calificaciones obtenidas en pruebas de conocimientos y TJS. En el sector público se ha investigado la relación entre la justicia percibida y el desempeño en los tests (McCarthy, Hrabluiky y Jeller, 2009; Smither et al., 1993), aunque no se ha estudiado la relación entre las reacciones de los candidatos y el desempeño laboral, lo que hace que sea necesario investigar sobre esta cuestión. Dadas las características de la selección en el sector público y la naturaleza multidimensional del constructo justicia procedimental (Colquitt et al., 2001; Gilliland y Steiner, 2014) se antoja necesario medir tres dimensiones de la justicia percibida por los participantes en los procesos selectivos y su relación con los resultados en las pruebas y el desempeño laboral: 1) la adecuación de la dificultad de las pruebas (Arvey, Strickland, Drauden y Martin, 1990; Hong, 1999; Puertas y Embid, 2011; Rodríguez Garraza, 2008), 2) su grado de adecuación al temario de la convocatoria, para garantía de las expectativas razonables de los candidatos y ofrecer seguridad jurídica (Chaves, 2009), lo que está vinculado con el principio de transparencia exigido por la legislación y es próximo conceptualmente a la dimensión justicia informativa del modelo de justicia procedimental de Gilliland (1993), y 3) su relación con el contenido y las tareas del puesto a cubrir, la dimensión más relevante del modelo de ( Gilliland, Osca y Salmones, 2004; Ployhart y Ryan, 1998). Estos tres aspectos reflejan el nivel de satisfacción global con la justicia procedimental del proceso selectivo, es decir, si las pruebas se perciben como justas y adecuadas al proceso y si la toma de decisiones, las reglas y el procedimiento empleados para la decisión selectiva se dan de forma equitativa y justa (Bauer et al., 2001; Hausknecht et al., 2004; Osca y Salmones, 2004). En base a la investigación previa, establecemos las siguientes hipótesis: H6. La percepción de los candidatos presentará una correlación positiva con las calificaciones en las pruebas selectivas (prueba de conocimientos y TJS) para el puesto de auxiliar administrativo/a. H7. La percepción de los candidatos presentará una correlación positiva con el desempeño del trabajo del personal auxiliar administrativo contratado. Estudio 1 Método Participantes. La muestra estuvo compuesta por 101 personas (23 varones y 78 mujeres), con una edad media de 39.5 años (SD = 6.03) que superaron el proceso selectivo para la selección de auxiliares administrativos en 2010 y estaban trabajando en el Gobierno Vasco durante el año 2016 y cuyos superiores aceptaron evaluar su desempeño. Medidas. En este estudio se han empleado las siguientes medidas: Prueba de conocimientos. Se empleó un cuestionario de 100 preguntas con cuatro alternativas de respuesta, en las que se penalizaron las respuestas erróneas. Por cada respuesta errónea se descontó la tercera parte del valor de una respuesta correcta. La puntuación máxima alcanzable por los candidatos según las bases de la convocatoria era de 27 puntos. Esta prueba era obligatoria y eliminatoria. Se trató de una prueba de conocimientos relacionados con los contenidos exigidos por el puesto determinados previamente mediante la herramienta de análisis de puestos del Gobierno Vasco (Gorriti y López Basterra, 2010). En su diseño se cuidó especialmente que todos los apartados del temario estuvieran representados en las preguntas. Se ofrecen ejemplos de preguntas de esta prueba en el Apéndice. La fiabilidad de esta prueba (alfa de Cronbach) fue de .81. Test de juicio situacional (TJS). Se empleó un cuestionario de 47 preguntas con cuatro alternativas de respuesta (de las cuales solo una era correcta), en las que se penalizaron las respuestas erróneas del mismo modo que en la prueba de conocimientos. De las 47 preguntas, 36 hacían referencia a 8 casos prácticos y las 11 preguntas restantes contaban con enunciados que planteaban situaciones prácticas de diversa índole. La puntuación máxima alcanzable por los candidatos según las bases de la convocatoria fue de 42 puntos. Esta prueba era obligatoria y eliminatoria. En el diseño de esta prueba destinada a medir los conocimientos de los aspirantes se trató de abarcar el mayor número posible de tareas evaluables mediante una prueba tipo test en función del análisis del puesto, ya que las bases de la convocatoria establecían que debía basarse en el temario y en las tareas del puesto convocado. Se planteaban situaciones a las que se podían enfrentar los auxiliares administrativos en su día a día a las que debían responder aplicando al caso concreto sus conocimientos. Se ofrecen ejemplos de preguntas de esta prueba en el Apéndice. Su fiabilidad (alfa de Cronbach) fue de .51. Experiencia. Se consideró experiencia a los servicios prestados en la Administración Pública en un puesto de contenido igual o similar al de las funciones del puesto convocado. El cómputo de la experiencia se efectuó realizando la suma de los periodos trabajados, valorándose a razón de .12 por mes trabajado hasta un máximo de 22 puntos, lo que equivalía a un máximo de 15 años de experiencia según las bases de la convocatoria. Dada la naturaleza de esta medida, no se pudo computar su fiabilidad. Titulaciones académicas. Se valoraron hasta un máximo de 6 puntos las ti-tulaciones académicas oficiales diferentes a la aportada para acceder al proceso selectivo que se consideraron útiles para desempeñar el puesto de Auxiliar Admi-nistrativo: titulaciones de FP II en Administración y Finanzas, Secretariado, Gestión Administrativa, etc. La fiabilidad de esta medida (alfa de Cronbach) fue de .75. Conocimientos de informática. Se valoraron hasta un máximo de 2 puntos los conocimientos en Excel, Access, Internet y PowerPoint acreditados mediante el sistema de certificación IT-Txartela. La fiabilidad de esta medida (alfa de Cronbach) fue de .78. Conocimientos de idiomas. Se valoraron los conocimientos de inglés y francés de nivel igual o superior al B1 del Marco Común Europeo de Referencia hasta un máximo de 1 punto en inglés y francés. Dada la naturaleza de esta medida, no se pudo computar su fiabilidad. Medidas del criterio: evaluación del desempeño. Para la evaluación del desempeño laboral se diseñó una herramienta compuesta por 26 escalas de valoración con anclajes conductuales que medían dos dimensiones: desempeño de tarea y desempeño contextual. Para elaborar los anclajes conductuales se recogieron incidentes críticos proporcionados por tres expertos en el puesto de auxiliar administrativo/a con más de 5 años de experiencia. Dado que la manifestación conductual del desempeño de tarea varía con el puesto (Borman, Penner, Allen y Motowidlo, 2001; Gorriti y López Basterra, 2009) y que es conveniente que las dimensiones de tarea se identifiquen a partir del análisis de puestos (Bernardin y Beatty, 1984; Díaz-Cabrera et al., 2014; Murphy y Cleveland, 1995; Peiró, Ramos y Cortés, 2012) se optó por elaborar una herramienta específica del puesto objeto de evaluación. Así, la dimensión desempeño de tarea se compuso de 5 subdimensiones: atender consultas y reclamaciones (medida mediante 4 ítems), comprobar y cotejar datos, registros y documentación (3 ítems), alimentar y actualizar bases de datos y aplicaciones informáticas (3 ítems), elaborar certificaciones, notificaciones, compulsas, etc. (2 ítems) y tramitar expedientes (3 ítems). Las 5 subdimensiones fueron elegidas de entre las tareas más representativas del puesto en base a la información aportada por la herramienta de análisis de puestos del Gobierno Vasco (Gorriti y López Basterra, 2010) por ser aquellas para las que los expertos en el puesto elaboraron más incidentes críticos. La dimensión desempeño contextual se diseñó en base al modelo de Borman et al. (2001) y estaba compuesta por 4 subdimensiones: ayuda y cooperación (medida mediante 5 ítems), iniciativa (2 ítems), persistencia/tenacidad (2 ítems) y autodesarrollo (2 ítems). La escala de evaluación de cada ítem contó con cinco niveles (de 1, el nivel de desempeño más negativo o inadecuado, a 5, el nivel de desempeño más positivo o adecuado). La media de las puntuaciones en desempeño de tarea (DT) y desempeño contextual (DC) permitió obtener un valor de desempeño general (DG). El coeficiente alfa de Cronbach de DG, DT y DC fue, respectivamente, de .92, .89 y .86. Los coeficientes alfa de las subdimensiones oscilaron entre .63 y .91. Por otro lado, además de este cuestionario de evaluación de desempeño convencional, dada la tendencia de los evaluadores a asignar puntuaciones elevadas, lo que se conoce como sesgo de benevolencia (Aguinis, 2013; Díaz Cabrera et al., 2014), o a igualar las puntuaciones de los evaluados (Peiró et al., 2012), es decir, sesgo de tendencia central, se utilizaron otros dos cuestionarios basados en la comparación entre empleados para que los superiores con más de un evaluado comparasen el desempeño de sus subordinados en 8 subdimensiones. Las 4 primeras medían DT y fueron identificadas en base a los criterios de ejecución obtenidos para las tareas del puesto de auxiliar a partir de la herramienta de análisis de puestos del Gobierno Vasco (cantidad de trabajo, satisfacción de demanda de información, garantizar la eficacia e igualdad de actuaciones de la Administración, asegurar la relevancia y corrección de datos/información) y las 4 últimas se correspondían con las dimensiones que medían DC en el cuestionario de desempeño para todos los auxiliares (ayuda y cooperación, iniciativa, persistencia/tenacidad, autodesarrollo). El primer cuestionario se empleó con aquellos superiores con un número de subordinados entre 2 y 4, debiendo ordenarlos de mejor a peor desempeño en cada dimensión. Las puntuaciones en cada dimensión para cada evaluado podían ser, en función del orden, 0 ó 1 punto (con dos evaluados), 0, 1 ó 2 puntos (con tres evaluados) o 0, 1, 2 ó 3 (con 4 evaluados). Este primer cuestionario se empleó para evaluar el desempeño de 20 auxiliares. El segundo cuestionario se empleó con los que tenían 5 o más evaluados, debiendo realizar una distribución forzosa en tres niveles (escala de evaluación de 0 a 2 puntos), pudiendo situar en los niveles superior (2 puntos) e inferior (0 puntos) únicamente a una persona. Este segundo cuestionario se empleó para evaluar a 7 auxiliares. En estos dos cuestionarios de comparaciones forzosas, la puntuación de cada auxiliar en DG, DT y DC se obtuvo a partir de la proporción entre los puntos acumulados en cada dimensión y el máximo de puntos que podían recibir en cada dimensión (8 puntos en DT y DC en el caso de tres evaluados, 4 puntos en DT y DC en el caso de 2 evaluados). La fiabilidad (entendida como alfa de Cronbach) para las medidas de DG, DT y DC obtenidas mediante comparaciones forzadas con el primer cuestionario (n = 20) fue de .96, .94 y .93 respectivamente. Se facilitó a los evaluadores un manual con información precisa acerca los criterios de valoración del desempeño y el procedimiento para puntuarlo según el tipo de cuestionario, los sesgos a considerar, las definiciones conceptuales de cada dimensión y los anclajes conductuales a emplear. Además, se ofreció un teléfono de atención de consultas para que los evaluadores pudieran solucionar sus dudas con respecto a la evaluación. Los superiores directos, jefes de servicio que tienen la oportunidad de observar continuamente el desempeño de sus subordinados, evaluaron el desempeño de los sujetos que conformaron la muestra durante el último año. Procedimiento. En el procedimiento selectivo convocado por el Gobierno Vasco para seleccionar 155 auxiliares administrativos se inscribieron 13,700 personas. De estas, 2,141 aprobaron los ejercicios eliminatorios (conocimientos y TJS) y por tanto podían ser contratados, en función de la nota final obtenida (la suma de las puntuaciones en todos los instrumentos selectivos mencionados en el apartado Medidas), para desempeñar bien un puesto fijo como funcionarios de carrera (lo que lograron los 155 con mejores notas finales) o bien un puesto temporal como funcionarios interinos. Los resultados del procedimiento selectivo ya obraban en manos del IVAP (registros informatizados de las 2,141 personas que superaron el proceso selectivo de la oferta pública de empleo al cuerpo de auxiliares administrativos/as del Gobierno Vasco celebradas en 2010). De esas 2,141 personas, 339 estaban trabajando como auxiliares administrativos en el Gobierno Vasco en 2016 y para obtener los datos de desempeño era necesario contar con la colaboración de sus superiores directos. Para ello se solicitó a los distintos departamentos del Gobierno su colaboración. Finalmente, se consiguió la colaboración de 77 superiores directos (43 mujeres y 34 varones que ocupaban jefaturas de servicio) que evaluaron el desempeño de 101 de las 339 personas contratadas tras haber superado la oposición; 10 de estos superiores evaluaron también el desempeño de 27 auxiliares mediante cuestionarios basados en la comparación entre empleados. Habida cuenta de que contar con apenas 27 cuestionarios de comparación forzosa implicaba un problema de potencia estadística, es decir, que aumente la probabilidad de que un test estadístico lleve al rechazo de la hipótesis nula, afirmar que no hay relación entre las variables cuando en realidad la hay (Cohen, 1988), se procedió de la siguiente manera: para poder agrupar en una escala única las puntuaciones obtenidas mediante comparaciones y distribuciones forzadas con las puntuaciones obtenidas mediante el cuestionario convencional (el cuestionario basado en anclajes conductuales) se transformaron en puntuaciones z los distintos tipos de puntuaciones para obtener una puntuación única en desempeño para el total de 101 auxiliares. Además, para estudiar con precisión la relación entre predictores y criterios, habiendo empleado instrumentos distintos en una misma muestra de sujetos, se empleó la correlación parcial para eliminar el efecto del tipo de instrumento. Los valores obtenidos se corrigieron para controlar los artefactos estadísticos de la misma manera que al emplear las medidas de criterio no basadas en comparaciones y poder calcular los valores de validez operativa. Se evaluó el desempeño a lo largo del año 2016 evaluando únicamente a aquellas personas con al menos un año de experiencia en el puesto. Los cuestionarios fueron cumplimentados en el lugar de trabajo mediante una aplicación que garantizaba el anonimato de las respuestas. Corrección de artefactos estadísticos. Para contrarrestar los errores debidos a artefactos estadísticos (errores no debidos a la varianza sistemática de los candidatos sino a errores de los propios instrumentos de medida), los coeficientes de validez se corrigieron primero por falta de fiabilidad del criterio -empleando el valor de .52 estimado como fiabilidad meta-analítica para pruebas de desempeño realizadas por superiores (Sackett, 2014; Salgado, 2015; Salgado et al., 2003; Salgado, Moscoso y Anderson, 2016; Salgado y Táuriz, 2014; Schmidt, Le e Ilies, 2003; Shen, Cucina, Walmsley y Seltzer, 2014; Viswesvaran, Ones y Schmidt, 1996; Viswesvaran, Ones, Schmidt, Le y Oh, 2014)- y después por restricción del rango directa -la restricción que se produce en la muestra como efecto de la propia selección, ya que sólo es posible evaluar el criterio en las personas contratadas-, teniendo en cuenta el valor de Ux, es decir, el cociente entre desviación típica para el rango total -el total de 2141 opositores aprobados- y la desviación típica para el rango restringido -la muestra de 101 personas seleccionadas cuyo desempeño se pudo evaluar- (Thorndike, 1949). Los valores de Ux oscilaron entre 0.78 y 1.95, indicándose en la Tabla 1. Para llevar a cabo las pruebas de significación de las correlaciones corregidas se siguieron las indicaciones de Salgado (1997) y Bobko y Rieck (1980). ResultadosEn las Tablas 1 y 2 se observan las medias y desviaciones típicas de los predictores y criterios empleados. En el caso de los procedimientos selectivos la media de la experiencia es de 6.42 (equivalente a 4.37 años de servicios en puestos similares). Por lo que se refiere a las medidas de desempeño, las medias son muy elevadas, estando cerca de la puntuación máxima de la escala, y las desviaciones típicas de DG, DT y DT han oscilado entre .54 y .70. La fiabilidad de estas medidas de desempeño fue adecuada (Nunnally, 1978), presentando valores superiores a .70 en todos los casos, con la excepción de persistencia/tenacidad.

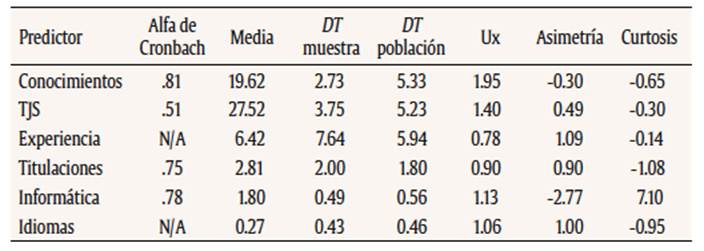

Tabla 1

Medias, desviación típica, fiabilidad, valores de la restricción del rango (Ux), asimetría y curtosis de los predictores del estudio 1

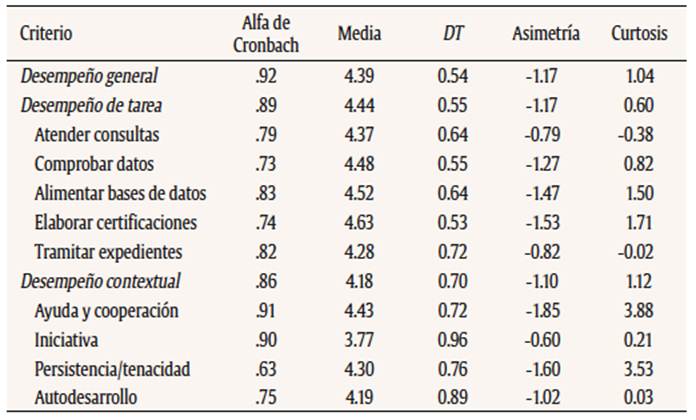

Tabla 2

Medias, desviación típica, fiabilidad, asimetría y curtosis de las medidas de criterio del estudio 1

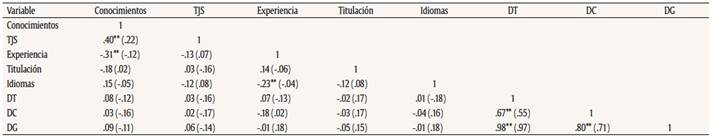

Los predictores del concurso de méritos presentan asimetría y/o curtosis, siendo el caso más destacado el de la variable conocimientos de informática. Lo mismo sucede con las variables que medían el desempeño laboral. En este caso, la mayor parte de variables presentan distribuciones asimétricas negativas, es decir, la mayor parte de los evaluadores han empleado las puntuaciones más altas de la escala, las que indicaban un mejor desempeño. Asimismo, se observan distribuciones leptocúrticas -puntuaciones concentradas en torno a la media de la escala- en algunos de los criterios empleados, siendo los casos más pronunciados ayuda y cooperación y persistencia/tenacidad. En cualquier caso, todas las variables, con la excepción de conocimientos de informática, presentan valores inferiores a los límites que indican problemas de normalidad, 2 para asimetría y 7 para curtosis (Curran, West y Finch, 1996). Dados estos valores, no se han calculado los valores de las correlaciones para este predictor. En las Tablas 3 y 4 se observan, respectivamente, la validez observada y la validez operativa (validez corregida por falta de fiabilidad de criterio y por restricción del rango) de los predictores empleados en la selección de auxiliares administrativos. Todos los límites de los intervalos de confianza de los predictores incluyeron el 0, por lo que no se obtuvieron correlaciones significativas. Por consiguiente, estos datos no permiten apoyar las hipótesis 1, 2, 3, 4 y 5. En cuanto a la magnitud de las correlaciones corregidas encontradas, la prueba de conocimientos presentó un valor de .24 con DG como criterio y de .22 con DT a partir de los valores de las correlaciones observadas (correlaciones entre .08 y .09). EL TJS presentó correlaciones corregidas muy bajas (entre .05 y .12), la experiencia osciló entre -.25 y .07, las titulaciones académicas presentaron valores entre -.06 y -.02 y el conocimiento de idiomas osciló entre -.16 y .02.

Tabla 3

Matriz de correlaciones observadas de las variables del estudio 1

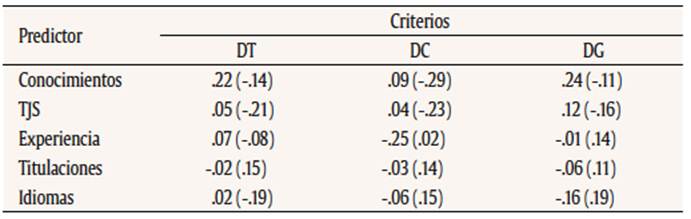

Tabla 4

Validez operativa de los predictores del estudio 1

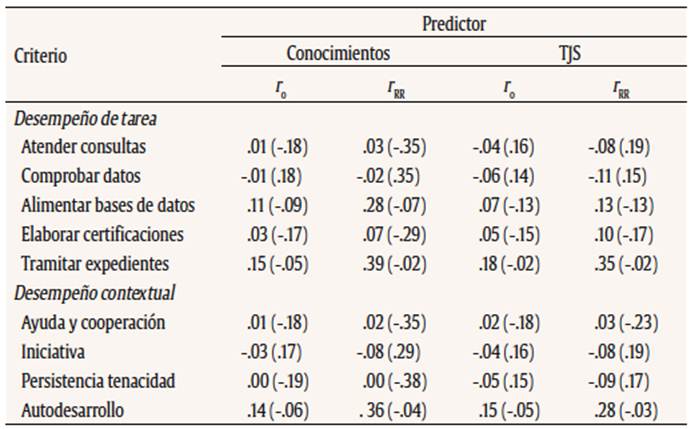

En cuanto a las correlaciones corregidas entre las pruebas eliminatorias y las subdimensiones de las medidas de criterio, la prueba de conocimientos presenta correlaciones corregidas más elevadas con tramitar expedientes, .39, y autodesarrollo, .36, y los valores de las correlaciones observadas respectivas fueron .15 y .14. Del mismo modo, el TJS presenta las correlaciones corregidas más elevadas con tramitar expedientes, .35, y autodesarrollo, .28, y los valores de las correlaciones observadas respectivas fueron .18 y .14 (Tabla 5).

Tabla 5

Correlaciones de la prueba de conocimientos y el TJS con las subdimensiones de desempeño del estudio 1

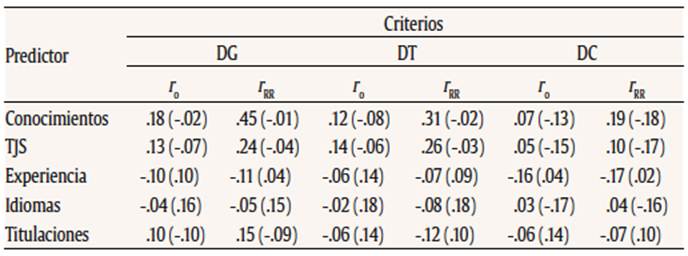

Ante la escasa variabilidad y las elevadas puntuaciones observadas en las medidas de criterio se midió el desempeño empleando cuestionarios de comparaciones y distribuciones forzadas y se obtuvieron puntuaciones en DG, DT y DC para los 27 auxiliares evaluados cuyos superiores tenían más de un evaluado, de manera que se pudiera observar el efecto de las comparaciones y distribuciones forzadas en las correlaciones entre predictores y criterios. En la Tabla 6 se observa cómo la validez operativa de la prueba de conocimientos asciende a .45 con DG como criterio, si bien no es significativa (p = .08). El resto de predictores presentaron límites del intervalo de confianza que incluían el 0.

Tabla 6

Validez observada y operativa de los predictores del estudio 1 empleando medidas de criterio con comparaciones y distribuciones forzosas

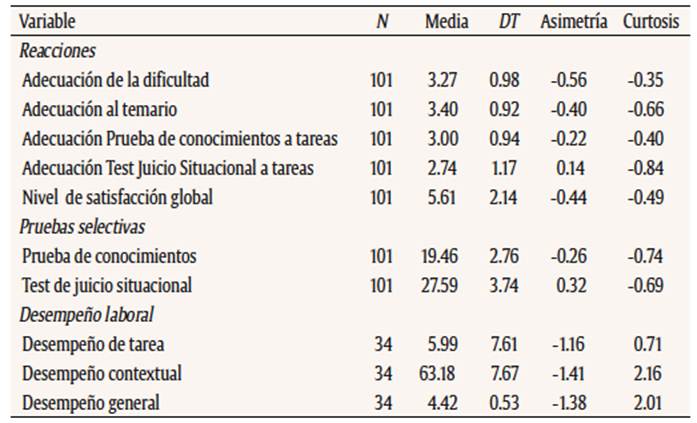

Estudio 2 Método Participantes. La muestra estuvo compuesta por 101 personas (32 varones y 69 mujeres), con una edad media de 39.39 años (SD = 6.29) que superaron el proceso para la selección de auxiliares administrativos en 2010, estaban trabajando en el Gobierno Vasco durante el año 2016 y aceptaron cumplimentar el cuestionario de evaluación de las reacciones de los opositores. Esta muestra no coincide con la del estudio 1 más que en 34 sujetos, los de aquellos auxiliares cuyos superiores directos, en este caso 10 jefes de servicio, aceptaron evaluar el desempeño laboral de sus subordinados. Medidas. En este estudio se han empleado las siguientes medidas: Predictores. De los instrumentos selectivos empleados en la oposición del Gobierno Vasco para la plaza de auxiliar administrativo, siguiendo el modelo de McCarthy et al. (2013), únicamente se tuvieron en cuenta las pruebas con carácter eliminatorio, es decir, la prueba de conocimientos y el TJS, ambos descritos en el estudio 1. Reacciones de los candidatos. Las reacciones de los candidatos se midieron mediante un cuestionario de 5 ítems que evaluaron respectivamente la adecuación de la dificultad de las pruebas eliminatorias (conocimientos y TJS), el grado de adecuación al temario de las pruebas eliminatorias, el grado de adecuación a las tareas del puesto de la prueba de conocimientos, el grado de adecuación a las tareas del puesto del TJS y el nivel de satisfacción global con respecto a la justicia procedimental del proceso selectivo y la adecuación de las pruebas empleadas. Los 4 primeros ítems se evaluaron mediante una escala de 5 puntos (de 1 a 5), reflejando 1 un nivel muy inadecuado y 5 muy adecuado, y el ítem relativo a la justicia procedimental se evaluó de 0 a 10. La consistencia interna de la escala fue de .83. Además, para poder interpretar de manera adecuada las valoraciones cuantitativas de los auxiliares, estos tuvieron la oportunidad de manifestar sus impresiones mediante un ítem de respuesta abierta. Para analizar con mayor precisión las respuestas cualitativas de los auxiliares, se realizó un análisis de contenido de sus valoraciones dadas en dicho ítem (Graneheim y Lundman, 2004). Evaluación del desempeño. Se evaluó el desempeño de cada participante mediante el cuestionario de evaluación del desempeño convencional basado en anclajes conductuales descrito en el estudio 1. No se emplearon los cuestionarios de comparaciones y distribuciones forzosas. Procedimiento. Se solicitó a las 339 personas que estaban trabajando en el Gobierno Vasco tras haber aprobado el proceso selectivo de 2010, es decir, tras haber superado la prueba de conocimientos y el TJS, que respondiesen al cuestionario para evaluar sus percepciones con respecto a la justicia de las pruebas y del procedimiento selectivo del año 2016. El cuestionario fue cumplimentado en su lugar de trabajo por los 101 auxiliares administrativos que aceptaron participar mediante una aplicación que garantizaba el anonimato en sus respuestas. Aproximadamente tres meses después su desempeño laboral fue evaluado por parte de sus superiores directos siguiendo el procedimiento descrito en el estudio 1. Las reacciones de los candidatos se pudieron correlacionar con sus resultados en el proceso selectivo, que ya figuraban en el registro del IVAP. De los 101 auxiliares que rellenaron el cuestionario de reacciones 34 fueron evaluados por sus superiores mediante el cuestionario de evaluación de desempeño. Resultados Del análisis de las reacciones de los auxiliares cabe concluir que su valoración de la adecuación de la dificultad, adecuación al temario, adecuación a las tareas de la prueba de conocimientos y nivel de satisfacción general con la equidad del proceso es positiva, ya que las puntuaciones medias en estos aspectos están en el punto medio de las respectivas escalas o ligeramente por encima. No sucede lo mismo en cuanto a la valoración de la prueba TJS. En este caso la media es de 2.74 (Tabla 7).

Tabla 7

Medias, desviaciones típicas, tamaño muestral, asimetría y curtosis de las medidas empleadas en el estudio 2

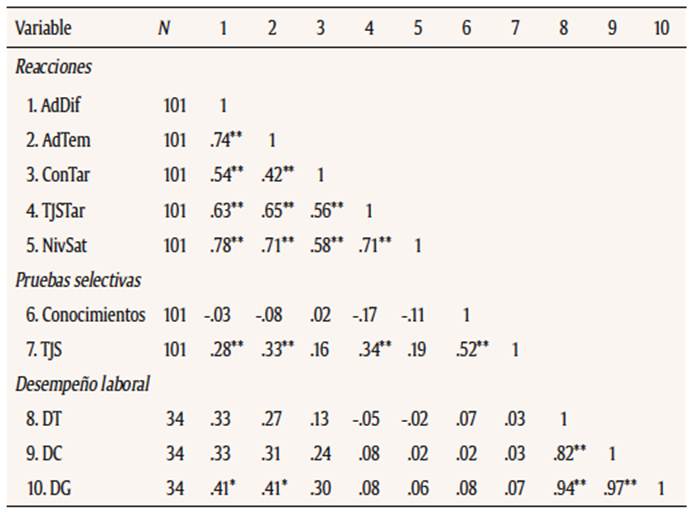

Por lo que se refiere a las correlaciones entre las variables empleadas en el estudio 2, como se puede comprobar en la Tabla 8, el resultado en la prueba TJS presenta una correlación significativa con la adecuación de la dificultad percibida del proceso selectivo, .28, la adecuación al temario, .33, y la adecuación de la prueba de TJS a las tareas del puesto, .34. Sin embargo, el resultado en la prueba de conocimientos no presenta ninguna correlación significativa con las reacciones de los candidatos. En consecuencia, la hipótesis 6 se cumple parcialmente solo para el TJS.

Tabla 8

Matriz de correlaciones de las medidas empleadas en el estudio 2

En cuanto a la relación entre reacciones y evaluación del desempeño, DG presenta correlaciones significativas con la adecuación de la dificultad percibida del proceso selectivo y la adecuación al temario, con un valor de .41 en ambos casos. Por consiguiente, la hipótesis 7 se cumple parcialmente. Por último, la mayor parte de las valoraciones (más del 46% del total) expresadas por los auxiliares en el ítem de respuesta libre reflejan desacuerdo con las características del TJS, especialmente en cuanto a su desajuste con las funciones y tareas del puesto, así como en cuanto a la información dada sobre sus características antes de la celebración de la misma. Discusión GeneralSe ha encontrado una baja validez predictiva para la mayor parte de los aspectos valorados en el proceso selectivo, siendo la prueba de conocimientos la que presenta magnitudes más altas, con un valor corregido idéntico, .24, al encontrado por Berges (2011) con una muestra de policías, pero muy inferior al apuntado por el metaanálisis de Dye et al. (1993), .45. No obstante, se aproxima al valor hallado por dicho metaanálisis para puestos de baja complejidad y pruebas de moderada similitud al contenido del puesto, aspecto este último que coincide con las reacciones indicadas por los auxiliares de la muestra del estudio 2. Esta diferencia entre el valor hallado y el del metaanálisis puede deberse a que, como señala Táuriz (2014), los exámenes de oposición muchas veces incluyen contenidos de tipo jurídico que no están directamente relacionados con el puesto en sí, por lo que cabe esperar que su validez predictiva sea inferior a .45. Esta cuestión apunta a la necesidad de realizar estudios de validez de contenido para mejorar la adecuación de las pruebas al contenido de los puestos ofertados según las directrices de Lawshe (1975), Choragwicka (2007) o Choragwicka y Moscoso (2007). Esto es relevante ya que la similitud o la correspondencia conceptual entre el dominio del constructo de los predictores y el dominio del constructo de los criterios aumenta la magnitud del coeficiente de validez (Binning y Barrett, 1989; Christian et al., 2010; Lievens, Buyse y Sackett, 2005). En esta investigación tanto la prueba de conocimientos como el TJS presentan una correlación de tamaño medio a la hora de predecir tramitación de expedientes, la medida de criterio más relacionada con el importante peso concedido en el temario al conocimiento de la legislación sobre procedimiento administrativo. Asimismo, tanto la prueba de conocimientos como el TJS presentan correlaciones de tamaño medio con autodesarrollo, criterio que medía el interés por la formación y la adquisición de conocimientos y podría vincularse con el aprovechamiento formativo. La magnitud de la correlación corregida encontrada con la prueba de conocimientos como predictor se aproxima a la encontrada por el metaanálisis de Dye et al. en 1993 para predecir el aprovechamiento formativo, .47. La prueba de TJS no presenta correlaciones distintas de 0 con DG, DT o DC en nuestra muestra, alcanzando valores corregidos entre .05 y .12, muy inferiores a los encontrados para el conjunto de TJS por el metaanálisis de McDaniel y Nguyen (2001), .34. Una posible explicación es que el TJS empleado en esta investigación medía exclusivamente conocimientos y, como hallaron Christian et al. (2010), la validez de criterio de los TJS varía en función del constructo medido. En dicho metaanálisis los TJS que medían constructos como destrezas interpersonales, liderazgo o personalidad presentaron valores que oscilaron entre .25 y .43, mientras que los que medían conocimientos tuvieron el valor más bajo de todos los constructos medidos, .19. La experiencia, por su parte, presenta valores muy bajos en cuanto a su validez predictiva del desempeño general y de tarea, presentando unos valores cercanos a cero, lo que coincide con lo apuntado por Sturman (2003) o McDaniel y Nguyen (2001) cuando los seleccionados son en gran parte los que tienen mucha experiencia en el puesto, como en este caso, y además se corresponde con los datos hallados por el estudio de Berges (2011) en una muestra de empleados públicos. Por otro lado, las evaluaciones de desempeño con comparaciones forzadas han ayudado a elevar el tamaño de la validez operativa de la prueba de conocimientos hasta .45 y la del TJS hasta .24, algo que cabía esperar en base a lo apuntado por Berger, Harbring y Sliwka (2013), que encontraron que este tipo de evaluación del desempeño contribuía a evitar el sesgo de benevolencia y a discriminar mejor entre los evaluados, algo que contribuye a aumentar al tamaño de la correlación (Smith y Smith, 2005). La magnitud de las correlaciones de las titulaciones académicas ha sido baja, si bien era algo que cabía esperar en base a los datos metaanalíticos. Asimismo, se han obtenido valores bajos en el conocimiento de idiomas, por lo que, dada la escasez de investigaciones, es preciso seguir profundizando en el conocimiento de las relaciones entre esta variable y el desempeño laboral. En ambos casos, como señala Schneider (1994), cabe argumentar que no se puede presumir que todas las personas que hayan acreditado un título o certificado formativo tengan el mismo nivel de destrezas laborales y, como señalan Dye y Reck (1988), el nivel educativo, más allá de cierto punto no produce mejoras en el desempeño. En cuanto a los resultados del estudio 2, cabe destacar que la puntuación en TJS presenta una correlación significativa con adecuación de la dificultad, adecuación al temario y adecuación al contenido del puesto, con magnitudes superiores a las encontradas por el metaanálisis de Hausknecht et al. (2004). No ha sucedido lo mismo con la prueba de conocimientos, que no presenta correlaciones significativas con ninguno de los ítems que medían las reacciones de los auxiliares. Una posible explicación la encontramos en los trabajos de Bauer y Truxillo (2006) o Chan, Schmitt, Sacco y DeShon (1998), que indican que las reacciones negativas ante pruebas que miden desempeño máximo, es decir, pruebas que exigen el máximo esfuerzo posible a los candidatos (Klehe y Anderson, 2007), pueden provocar un descenso en la motivación para rendir adecuadamente. La media de las reacciones ante el TJS es inferior a la de la prueba de conocimientos, por lo que cabría plantear que las percepciones más negativas a esta prueba hayan tenido un efecto perjudicial en los resultados. Esta reacción negativa, expresada por un 46% de auxiliares en el ítem de respuesta abierta, es algo que investigaciones como la de Patterson et al. (2011) han comprobado al abordar la selección de profesionales de medicina general en el National Health Service (NHS) británico. Al introducir los TJS a finales de la década pasada, fueron inicialmente percibidos por los candidatos como pruebas de menor validez aparente que las pruebas de conocimientos, aunque, tras ofrecer más información con respecto a los TJS en años posteriores, estos fueron evaluados de manera más positiva en cuanto a su relación con el puesto. No obstante, también hay que considerar el posible sesgo de interés personal [self-serving bias] señalado por Chan y Schmitt (1997). Es decir, cabe considerar que sean los resultados en la prueba los que determinen las percepciones acerca de la prueba, teniendo en cuenta que la medición de las reacciones de los auxiliares se hizo una vez conocidos los resultados. Sin embargo, el hecho de que las correlaciones únicamente hayan sido significativas en el caso de la prueba TJS hace que cobre más fuerza la hipótesis que indica que son las reacciones las que provocan los resultados. Más relevante si cabe es la correlación significativa que presentan adecuación de la dificultad y adecuación al temario con el desempeño general, lo que indica una posible relación directa entre reacciones y desempeño, posibilidad ya señalada por Colquitt et al. (2001) o McCarthy et al. (2013). Como señalan estos últimos autores, una posible interpretación es que las personas que no creen en la validez de las pruebas selectivas puedan desarrollar desconfianza hacia las evaluaciones, las políticas o los procedimientos de la organización, lo que a su vez está relacionado con la teoría de la equidad heurística [fairness heuristic theory], en la que Lind (2011) sugiere que las personas se forman impresiones de equidad de manera temprana y que estas impresiones moldean las percepciones y las conductas posteriores, por lo que las reacciones a las pruebas pueden tener consecuencias en las conductas posteriores a la contratación. Limitaciones y Futuras Investigaciones Como limitación del presente trabajo es necesario mencionar que la muestra se ha formado exclusivamente con auxiliares administrativos, por lo que es preciso realizar estudios similares para otros puestos del sector público para confirmar lo encontrado en esta investigación. El tamaño de la muestra en el estudio 2 es pequeño y consecuentemente los resultados encontrados pueden variar si la muestra aumenta, aunque la magnitud de las correlaciones halladas es un factor que apunta a seguir investigando en la línea de lo planteado por este trabajo en futuras investigaciones de índole similar. Por otro lado, el hecho de haber recogido las reacciones de los auxiliares, tras haber realizado los tests y teniendo conocimiento de sus resultados, aunque permite que los participantes puedan evaluar de una manera adecuada la relación entre los contenidos del puesto y el test, también puede provocar el sesgo de interés personal, algo que se puede aclarar siguiendo el enfoque de Chan et al. (1998) y midiendo también las reacciones antes de realizar los tests. Además, el lapso de tiempo transcurrido entre la celebración del proceso selectivo y la obtención de los datos del estudio 2, 6 años, hace que no sea posible descartar la acción de variables extrañas que hayan podido afectar a los resultados, como satisfacción laboral, relaciones con los superiores, etc. Por ello, en futuros estudios convendría reducir el tiempo entre la celebración de las pruebas y la obtención de las reacciones de los empleados. Implicaciones Prácticas Este trabajo es una de las escasas investigaciones en el ámbito público en cuanto a validez predictiva y reacciones de los candidatos, y tiene interesantes repercusiones prácticas que pueden llevar a la reflexión en cuanto al tipo de procedimientos selectivos a emplear en el sector público y en cuanto a la importancia relativa que se debe conceder a cada prueba, habida cuenta de la mayor capacidad predictiva de la prueba de conocimientos frente a la prueba de carácter más práctico, algo que coincide por lo señalado por el metaanálisis (Schmidt et al., 2016). Además, se antoja necesario reflexionar sobre el contenido de los temarios y los exámenes a aplicar, que deberían presentar una mayor similitud con las tareas de los puestos, algo que lleva a recomendar el uso de estudios de validez de contenido, y también sobre la manera de evaluar el desempeño, primando herramientas con comparaciones y distribuciones forzadas que ayuden a combatir los sesgos habituales en su uso en la Administración Pública, puntuaciones elevadas e iguales para todo el personal evaluado. Por último, la relación observada entre las reacciones de los participantes en los procesos selectivos y sus resultados en las pruebas y sobre todo en el desempeño es una cuestión muy a tener en cuenta en el diseño de los mismos, por lo que sería positivo poder realizar estudios similares en el futuro. Extended Summary The Basque Institute of Public Administration (IVAP) studied two crucial matters in the selection procedures for the public sector with a sample of administrative assistants: the predictive validity of selection tests and the way applicants perceive them. The Spanish legislation urges that selection should be made to predict future job performance and that procedures should be acceptable in terms of their psychometric properties of predictive validity, an issue which has not been frequently investigated in Spain with usual predictors such as knowledge tests or job-experience evaluations. Furthermore, results of different studies suggest there is a positive relationship between perception of procedural justice and test performance, i.e., people who have positive reactions to selection procedures obtain higher scores in those procedures and vice versa (Ryan, Sacco, McFarland, & Kriska, 2000; Smither, Reilly, Millsap, Pearlman & Stofey, 1993; Truxillo, Steiner, & Gilliland, 2004). Nevertheless, although some studies have emphasized the importance of analyzing the relationship between candidate perceptions and job performance (Chan & Schmitt, 2004; Ryan & Ployhart, 2000), this issue has seldom been studied. McCarthy et al. (2013) found that situational reactions affect job performance indirectly through their influence on the scores obtained. A literature review led to the following hypotheses: H1. Job knowledge test (JKT) scores will show a positive correlation with job performance: task performance (TP), contextual performance (CP), and overall performance (OP) of hired personnel. H2. The Situational Judgment Test (SJT) scores will show a positive correlation with job performance of hired personnel. H3. Job-experience evaluation will have a positive correlation with job performance of hired personnel. H4. The evaluation of academic degrees attained will have a positive correlation with job performance of hired personnel. H5. The evaluation of foreign language knowledge will have a positive correlation with job performance of hired personnel. H6. Candidates’ reactions (adequacy of tests’ difficulty, adjustment to the tests’ list of subjects, job-relatedness and procedural justice) will have a positive correlation with selection tests’ scores (JKT and SJT) of administrative staff. H7. Candidates’ reactions will have a positive correlation with job performance (TP, CP and OP) of administrative staff. Study 1 Method The sample consisted of 101 people (23 men and 78 women), with a mean age of 39.5 years (SD = 6.03) who passed a competition to hire administrative assistants and were working for the Basque Government during 2016 and whose superiors agreed to evaluate their performance. The predictors used were two pass/fail tests (a JKT and a SJT), job experience, academic degrees, computer knowledge, and foreign languages’ knowledge. Job performance was evaluated with a behaviourally-anchored rating scale (BARS) that measured TP (answering queries and complaints; data, records and documentation checking; feed and update databases and applications; elaboration of certifications, notifications, compulsions, etc.; processing administrative files) and CP (aid and cooperation; initiative; persistence-tenacity; self-development). Aside from this conventional questionnaire, two other types of job performance questionnaires based on rankings and forced distributions were also used to counter evaluators’ biases: one for superiors with two to four subordinates, and the other for superiors with more than five subordinates. The average scores for TP and CP allowed obtaining an Overall Performance (OP) value. To accurately study the relationship between predictors and criteria when using different instruments to assess job performance in the same sample of subjects, scores were transformed into z-scores and partial correlation was used to eliminate the effect of the type of instrument. Results No support was found for H1, H2, H3, H4 and H5, as all predictors had non-significant correlations. The JKT showed the highest positive corrected correlation with both OP, .24, and TP, .22, the SJT had corrected correlations between .05 and .12, and job-experience had values close to 0 (Table 1). As for the corrected correlations between eliminatory tests and the subdimensions of criterion measures, the highest correlations were found between JKT and processing administrative files, .39, and self-development, .36, and between SJT and processing administrative files, .35, and self-development, .28 (Table 5). Given the low variability and the high scores observed in the criterion measures (Table 2) performance was measured using rankings and forced distributions’ questionnaires and scores were obtained in OP, TP and CP for 27 workers. These results were considered along with performance assessed with the conventional, BARS-based questionnaire for the other 74 workers. Table 6 shows that the operational validity of the JKT rose to .45 with OP as a criterion. Study 2 Method The sample consisted of 101 administrative assistants (32 men and 69 women), with a mean age of 39.39 years (SD = 6.29) who passed a competition and were working for the Basque Government during 2016 and agreed to evaluate their reactions. Job performance of 34 of these 101 administrative assistants was assessed by 10 superiors who agreed to utilize the conventional questionnaires mentioned in study 1. Candidates’ reactions were measured with a 5-item questionnaire, which evaluated the adequacy of the difficulty of the screening phase tests, their degree of adjustment to the tests’ subject list, job relatedness of the JKT, job relatedness of the SJT, and overall satisfaction regarding the procedural fairness of the selection process and the adequacy of the tests used. The first four items were evaluated with a 5-point scale, while the item related to procedural justice was evaluated from 0 to 10. The internal consistency of the scale was .83. Results Partial support for H6 was found as SJT scores presented significant correlations with adequacy of the perceived difficulty of the selective process, adjustment to the subjects’ list and job relatedness of the SJT. However, scores in the JKT did not show significant correlations with candidates’ reactions. Regarding the relationship between reactions and performance, OP presents significant correlations with the adequacy of the perceived difficulty of the selection process and the adjustment to the subjects’ list, which partially supports H7 (Table 8). DiscussionThe JKT’s corrected value found for predictive validity, .24, is identical to that found by Berges (2011), but much lower than the one pointed out by the meta-analysis of Dye, Reck, & McDaniel (1993), .45. However, it is close to the value found by this meta-analysis for low complexity jobs and tests of moderate job-relatedness, which is in line with the reactions of the participants of study 2. An argument to explain the difference between the value found and that of meta-analysis of JKTs, as Táuriz (2014) points out, is that these tests often include content that is not job-related, i.e., constitutional or administrative law, so it can be expected that its predictive validity is less than .45. This points to the need of carrying out content validity studies to improve the job-content adjustment of tests. Nevertheless, low predictive validity has been found for all the other predictors used. The SJT does not present correlations different from 0 with the criteria in our sample, with values far from the magnitude found by the meta-analysis by McDaniel & Nguyen (2001), .34. A possible explanation is that SJTs that measure knowledge have criterion validity estimates lower than those measuring constructs such as interpersonal skills, personality, or leadership (Christian et al., 2010). Furthermore, the predictive validity of experience regarding OP and TP is close to zero, which is consistent with Sturman’s (2003) or McDaniel & Nguyen’s (2001) findings, since applicants selected were largely those with more job experience, and it matches the findings of Berges (2011) with a sample of public employees. Both academic degrees and foreign language presented low correlations with criteria, which is in line with previous research (Dye & Reck, 1988). It could be argued that it cannot be presumed that all people who have attained a degree or certificate of training have the same level of work skills, and, as pointed out by Dye and Reck (1988), the educational level, beyond a certain point, does not lead to improvements in performance (Schneider, 1994). An aspect that may have influenced the predictive validity of the predictors employed is the similarity or conceptual correspondence between the predictor construct domain and the construct domain of the criteria (Binning & Barrett 1989; Christian, Edwards, & Bradley, 2010; Lievens, Buyse, & Sackett, 2005). We must emphasize that both the JKT and the SJT have positive correlations when predicting processing administrative files, the criterion measure most related to the important weight given in the subjects’ list to the knowledge of administrative procedure. On the other hand, using performance appraisals with forced comparisons and rankings helped to increase the operational validity of the JKT and the SJT to .45 and .24 respectively, something that could be expected based on what was pointed out by Berger, Harbring, and Sliwka (2013). These results indicate that this type of appraisals could help to overcome the biases often present in conventional performance appraisals and should encourage the use of questionnaires with forced comparisons and rankings in future research. As for study 2, it is worth noting that scores in the SJT present significant correlations with adequacy of the difficulty, adjustment to the subjects’ list and job-relatedness, with magnitudes higher than those found by Hausknecht, Day, and Thomas’ (2004) meta-analysis. Even more relevant is the significant correlation between adequacy of the difficulty and adjustment of the subject list with OP, indicating a possible direct relationship between reactions and performance, a possibility already pointed out by Colquitt, Conlon, Wesson, Porter, and Ng (2001) or McCarthy et al. (2013). Nevertheless, the findings of this research, given the small size of the sample used in study 2, should be confirmed with later studies. This limitation, along with the time elapsed from the selection process to the implementation of study 2, 6 years, makes it impossible to rule out the action of extraneous variables that may have affected the results, something that must be considered in the interpretation of this results. This paper is one of the few studies in the Spanish public sector on predictive validity and candidates’ reactions, and has interesting practical repercussions: it should foster reflection on the selection procedures to be used as well as on the content of tests to be utilized, which should be more job-related, and at the same time, it should contribute to stress the relevance of both transparency of selection and participation of job incumbents in the design of tests in order to enhance their content validity. Referencias |

Correspondencia: alexander-rodriguez@ivap.eus (A. Rodríguez)

Copyright © 2026. Colegio Oficial de la Psicología de Madrid

e-PUB

e-PUB CrossRef

CrossRef JATS

JATS